AI 在自动化测试中的实践与挑战

最近在折腾AI辅助测试的事儿,有点心得,不吐不快。

说真的,最开始我就是想偷个懒。手动点点点、写重复的测试用例实在烦人,听说现在有些工具能靠AI自动生成测试脚本,我就寻思试试看。结果你猜怎么着?头一回用,让它给我测个登录页面,它噼里啪啦生成了几十个用例,连“密码输入框粘贴超长火星文”这种我都没想过的场景都覆盖了。 当时感觉,嚯,这玩意有点东西,效率是肉眼可见地上来了。

当时感觉,嚯,这玩意有点东西,效率是肉眼可见地上来了。

但没过多久就碰壁了。我们产品里有个挺复杂的交互流程,需要根据前一步的结果动态判断下一步。我把需求描述给它,生成的脚本跑起来却总是卡壳。它好像理解不了那种“如果A情况,则走B分支,但还要参考C状态”的逻辑链条,死板得很。这就好比,你告诉一个特别实心眼的朋友:“看情况灵活处理”,他回答:“好的,具体看哪种情况?每种情况对应的处理方案请列出。” 哭笑不得。

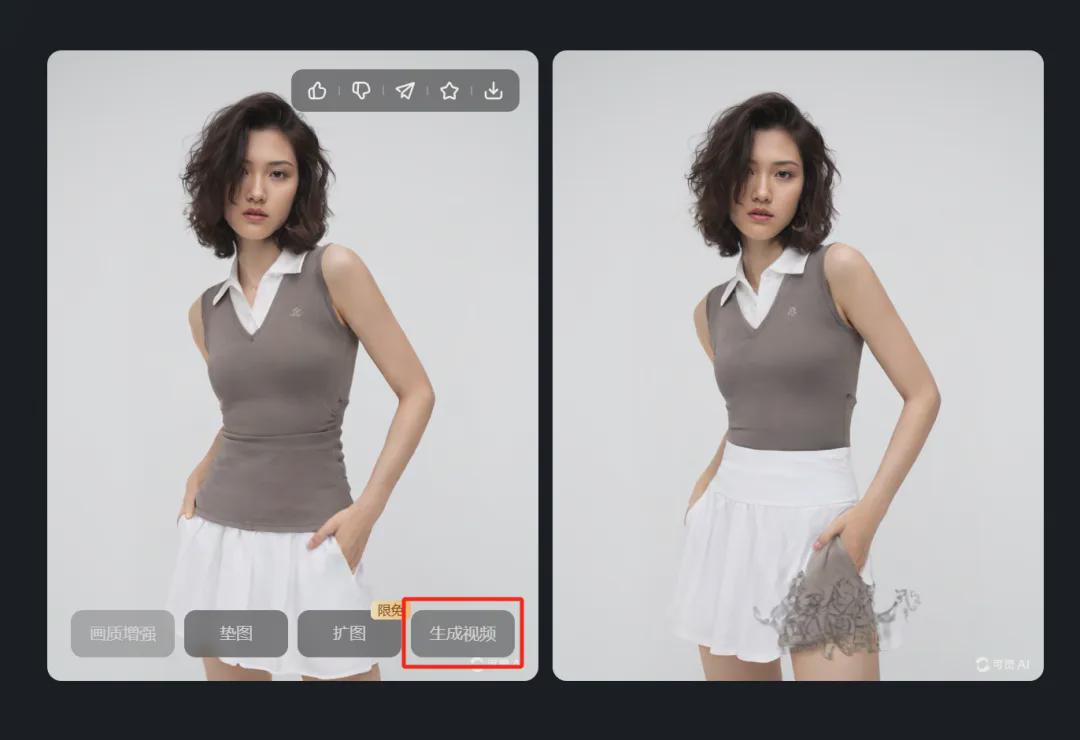

还有一次更逗。让它检查一个商品列表的图片显示,它真的一张张去比对了,然后报告说“第三行第二张图的模特嘴角像素与基准图有0.5%的偏差”。 这精度把我吓一跳,可问题是,那点偏差人眼根本看不出来,完全不影响功能。这事儿挺神奇的,AI在某些地方较真到离谱,在另一些需要常识判断的地方却又傻乎乎的。

这精度把我吓一跳,可问题是,那点偏差人眼根本看不出来,完全不影响功能。这事儿挺神奇的,AI在某些地方较真到离谱,在另一些需要常识判断的地方却又傻乎乎的。

我现在觉得,AI在测试里像个能力爆表但缺乏经验的实习生。它能不眠不休地干海量的重复劳动(比如回归测试),能发现一些人眼难以察觉的像素级差异,甚至能提供一些意想不到的测试角度。但它对业务逻辑的深层理解、对“什么是真正重要的bug”的判断,还有对模糊需求的解读,都还得靠人来带。

最大的挑战可能还不是技术,而是怎么跟它配合。你得学会给它下指令,不能太笼统,也不能太死板。有时候还得帮它收拾烂摊子,比如处理那些“误报”的bug。这个过程本身,也挺锻炼人的逻辑和表达。

不知道论坛里有没有也在用AI搞测试的朋友?你们遇到最头疼的情况是啥?有没有什么让AI“更懂你”的窍门可以分享分享?